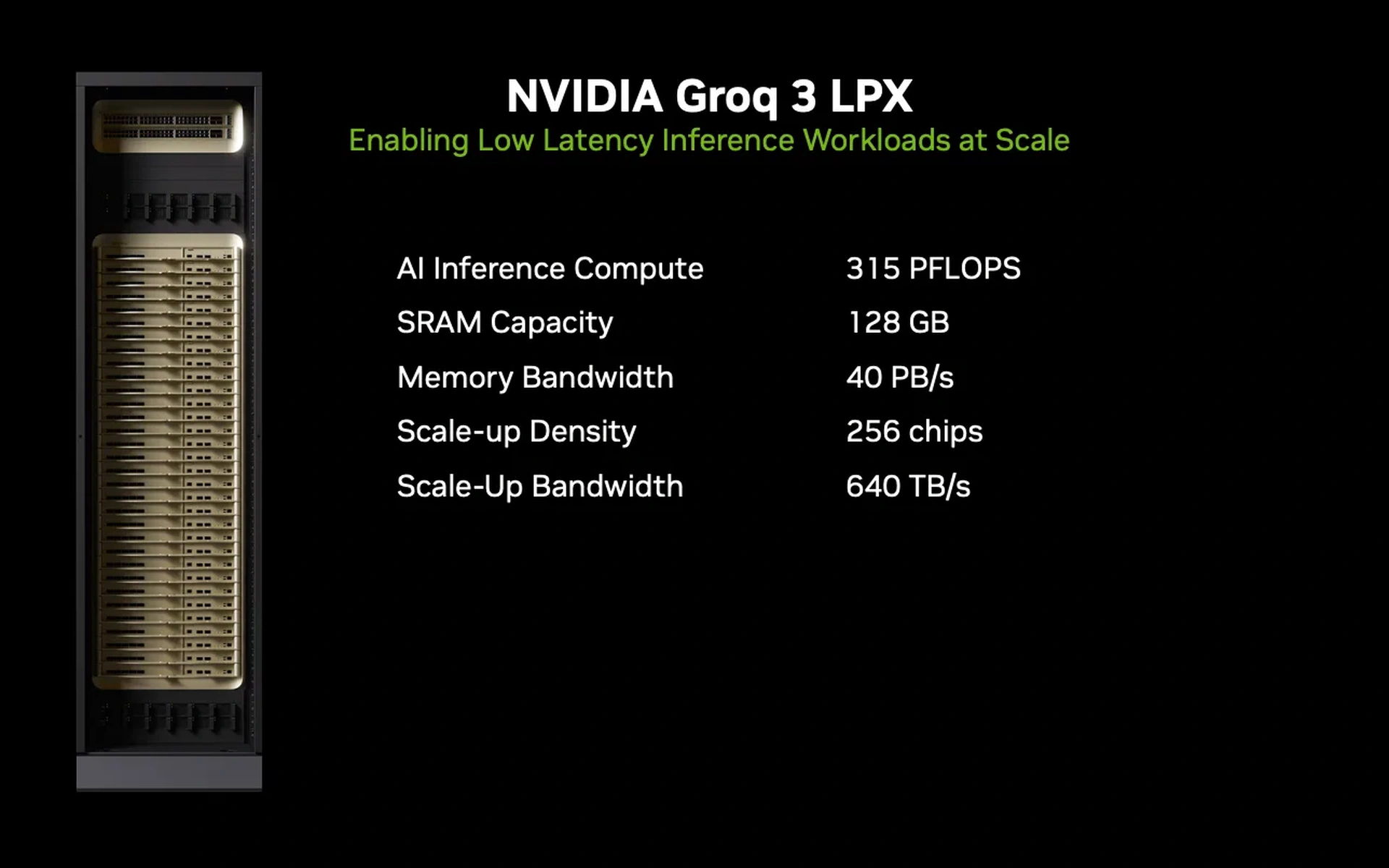

Es ist GTC Woche, das heißt für Jensen Huang Lederjacke an, ab auf die Bühne und den Rockstar der Halbleiter-Welt geben. Inmitten von 30.000 Fans im SAP Center (in San Jose, nicht Walldorf) rief er das „Zeitalter der Inferenz“ aus. Der Star der Show? Das Nvidia Groq 3 LPX Rack. Nvidia kaufte sich für 20 Milliarden Dollar bei dem Startup Groq ein. Durch die Kombination von deren Language Processing Units (LPUs) mit dem hauseigenen Vera Rubin System verspricht der Konzern nun Geschwindigkeiten, die 350-mal schneller sind als die Hopper-Generation.

Warum ist das wichtig?

Das Problem der kostspieligen Inferenz ist nicht neu, weshalb Groq bereits seit längerem heiß gehandelt wird. Kaum ist der Deal mit Nvidia unterschrieben, folgt auch schon das erste Produkt. Neben den für „Trainings“ (das Füttern der Modelle) prädestinierten GPUs, stellt Nvidia ein vollständiges Rack für die Phase der „Inferenz“ (das tatsächliche Arbeiten der Modelle bei Nutzeranfragen) vor.

Bisherige GPUs sind für die Antwort-Phase oft zu energiehungrig sowie durch Speicher-Engpässe zu langsam. Mit dem neuen Setup löst Nvidia genau diesen Flaschenhals und Jensen Huang träumt von 1 Billion Dollar Umsatz bis 2027.

Ein weiterer interessanter Aspekt ist, dass Samsung und nicht TSMC die Chips produziert. Samsung hatte vor wenigen Monaten schon die notwendigen Zulassungen erhalten. Und: Die offizielle Empfehlung von Jensen Huang ist es, ein Data Center mit 25 % Groq und 75 % Vera-Rubin auszustatten. Damit nur keiner auf Idee kommt, auf z.B. Googles TPU zurückzugreifen.